Po co łączyć on‑premise z chmurą w projektach AI

Główne motywacje: koszty, elastyczność, regulacje, wydajność

Architektura hybrydowa AI powstaje z bardzo pragmatycznych powodów. Rzadko jest efektem fascynacji nową technologią, częściej odpowiedzią na zderzenie kilku ograniczeń naraz: budżetu, dostępności specjalistycznego sprzętu, wymogów prawnych oraz oczekiwań biznesu co do jakości i szybkości działania systemów.

Jeśli całość AI trzymasz on‑premise, ogranicza cię przede wszystkim infrastruktura: liczba GPU, moc CPU, wielkość storage, przepustowość sieci wewnętrznej. Skalowanie w górę wymaga kolejnych wydatków inwestycyjnych (CAPEX), planowania zakupów i długich cykli wdrożeniowych. Z drugiej strony, jeśli przeniesiesz wszystko do chmury publicznej, zapłacisz w OPEX za każdy eksperyment, każdą godzinę trenowania modelu, każdy terabajt przesłanych danych. W wielu scenariuszach pełne „all‑in cloud” pod AI jest kosztowo i operacyjnie trudne do obrony.

Model hybrydowy pozwala wykorzystać to, co już masz lokalnie (serwery, macierze, sprzęt sieciowy), a brakujące zasoby dociągać z chmury w sposób kontrolowany. Dodatkowo regulacje – szczególnie w Europie – wymuszają trzymanie części danych wrażliwych na terenie konkretnego kraju lub wręcz w infrastrukturze własnej organizacji. To naturalnie popycha w kierunku mieszania środowiska on‑prem z chmurowym, zamiast prób umieszczenia wszystkiego po jednej stronie.

Architektura hybrydowa AI staje się szczególnie opłacalna, gdy system ma jednocześnie: wysokie wymagania w zakresie wydajności, duże wolumeny danych historycznych, epizodyczne piki obciążenia oraz twarde ograniczenia regulacyjne. Łączenie on‑premise z chmurą umożliwia dopasowanie środowiska do fazy cyklu życia modelu (trenowanie, tuning, inferencja) i do charakterystyki danych, zamiast wrzucać cały system do jednego „worka infrastrukturalnego”.

Typowe scenariusze hybrydowe: kto co robi

W praktyce szerokie spektrum systemów AI da się opisać kilkoma powtarzalnymi scenariuszami rozkładu ról między on‑prem a chmurę. Każdy z nich adresuje inny zestaw problemów.

Scenariusz 1: trenowanie w chmurze, inferencja lokalnie. Modele (np. głębokie sieci neuronowe, duże modele językowe domenowe) trenowane są w chmurze, gdzie dostępne są specjalistyczne GPU, elastyczne klastry obliczeniowe i gotowe usługi MLOps. Po uzyskaniu wersji produkcyjnej modelu jest on „pakowany” (np. jako kontener, paczka modelu) i wdrażany na infrastrukturze on‑prem, tuż obok systemów transakcyjnych. Ten wariant ma sens, gdy:

- udział trenowania w całkowitym czasie życia rozwiązania jest stosunkowo mały,

- potrzebujesz niskiej latencji inferencji (systemy w czasie rzeczywistym),

- dane inferencyjne są w większości lokalne i wrażliwe,

- nie chcesz utrzymywać dużej farmy GPU on‑prem tylko na potrzeby okresowych treningów.

Scenariusz 2: dane lokalnie, moc obliczeniowa w chmurze. Dane wrażliwe (np. finansowe, medyczne, dane klientów) są przechowywane i przetwarzane wstępnie on‑prem, ale ciężkie zadania trenowania lub analizy wysyłane są do chmury w postaci zanonimizowanej lub zagregowanej. Ten układ jest typowy dla instytucji mocno regulowanych, gdzie centralnym wymaganiem jest zgodność z RODO i kynem regulacji branżowych, a zarazem występuje potrzeba okresowego wykorzystania bardzo dużych mocy obliczeniowych.

Scenariusz 3: inferencja rozdzielona między edge, on‑prem i chmurę. Część logiki AI wykonuje się na urządzeniach brzegowych (edge), część na serwerach w lokalnym data center, a tylko szczególnie zasobożerne lub rzadko spotykane przypadki trafiają do chmury. Taki rozkład zapewnia kompromis między szybkością działania, niezawodnością a możliwościami „głębokiej” analizy lub korzystania z bardzo dużych modeli w chmurze.

Świadoma architektura hybrydowa vs prosty „lift‑and‑shift”

Wiele organizacji zaczyna „hybrydę” od pozornie prostego kroku: przeniesienia części komponentów do chmury bez zmiany ich logiki. To klasyczny lift‑and‑shift. Renderuje się to często w następujący sposób: baza danych zostaje lokalnie, aplikacja AI idzie do chmury, a pomiędzy nimi pojawia się VPN lub direct connect. Formalnie to architektura hybrydowa, lecz zwykle daleka od optymalnej.

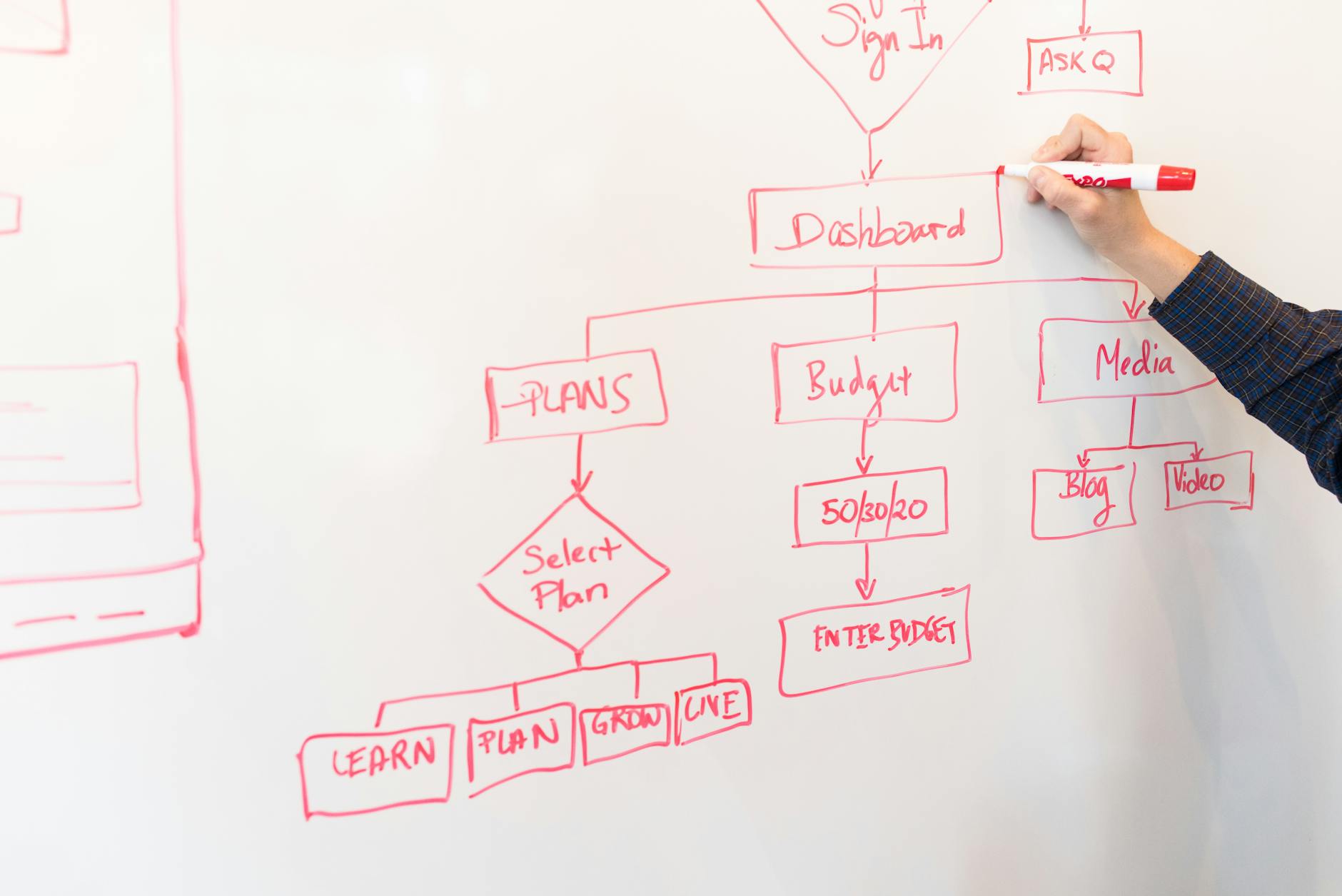

Świadome projektowanie architektury hybrydowej AI zaczyna się od pytania: które komponenty AI i które zbiory danych faktycznie zyskują na przeniesieniu w inne środowisko. Zamiast przerzucać całe serwisy „jak leci” do chmury, analizuje się:

- fazy przetwarzania danych (ingest, walidacja, feature engineering, trenowanie, inferencja, monitoring),

- charakterystykę ruchu (ciągły, burstowy, sezonowy),

- wymagania co do latencji i dostępności,

- klasy wrażliwości danych.

Na tej podstawie komponuje się układ, w którym część funkcji pozostaje on‑prem (np. przetwarzanie danych wrażliwych, niskolatencyjna inferencja), a inne trafiają do chmury (np. eksperymenty z modelami, batchowe trenowanie, archiwizacja danych). Tylko wtedy architektura hybrydowa AI zaczyna przynosić realne zyski, a nie wyłącznie zwiększa złożoność.

Dlaczego „tylko chmura” lub „tylko on‑prem” często nie wystarczają

Architektura AI oparta wyłącznie na chmurze sprawdza się świetnie w młodych, szybko rosnących projektach, które nie są obciążone dziesiątkami systemów legacy i złożonym krajobrazem prawnym. W dojrzałych organizacjach problem jest jednak inny: ogromne zbiory danych historycznych już istnieją w silosach on‑prem, wiele systemów integruje się za pomocą sieci wewnętrznej, a polityki bezpieczeństwa zakładają ścisłą kontrolę nad miejscem przetwarzania danych. Migracja wszystkiego do chmury bywa skrajnie kosztowna i długotrwała, a czasem po prostu nierealna.

Z kolei wariant „tylko on‑prem” przy zaawansowanych projektach AI potyka się o skalę obliczeniową i tempo zmian w świecie narzędzi. Zapewnienie wewnątrz organizacji elastyczności porównywalnej z chmurą (np. autoskalujące się klastry GPU, zarządzane usługi MLOps, gotowe integracje z narzędziami open source) wymaga bardzo dużych inwestycji i dojrzałego zespołu platformowego. W praktyce kończy się to często „zatkaniem” działu infrastruktury przez potrzeby zespołów data science.

Model hybrydowy pozwala unikać skrajności. Infrastruktura on‑prem służy jako stabilne, przewidywalne środowisko dla krytycznych komponentów AI, podczas gdy chmura publiczna zapewnia elastyczność tam, gdzie potrzeby są zmienne lub eksperymentalne. Jeśli architektura zostanie zaprojektowana świadomie, przejścia między środowiskami przestają być problemem, a stają się narzędziem optymalizacji.

Kluczowe parametry decyzyjne: wydajność, latency, koszty, regulacje

Definiowanie wymagań niefunkcjonalnych: SLA, SLO, SLI

Decyzja, które fragmenty systemu AI umieścić w chmurze, a które on‑prem, powinna opierać się na precyzyjnie opisanych wymaganiach niefunkcjonalnych. Trzy pojęcia porządkujące temat to SLA (Service Level Agreement), SLO (Service Level Objective) i SLI (Service Level Indicator).

SLI to konkretna mierzona wielkość, np. czas odpowiedzi API modeli, procent żądań obsłużonych poniżej 100 ms, odsetek poprawnie przetworzonych komunikatów w kolejce czy średni koszt inferencji na 1000 zapytań. SLO określa cel dla SLI: np. 99,9% żądań w czasie poniżej 200 ms w godzinach szczytu. SLA to formalna umowa (wewnętrzna lub zewnętrzna), która mówi, jakie SLO muszą być dotrzymane, jakie są dopuszczalne odchylenia i konsekwencje.

Bez takiego uporządkowania łatwo wejść w dyskusję „czy chmura jest wystarczająco szybka” na poziomie opinii, zamiast danych. Jeśli wiesz, że część systemu AI ma odpowiadać w 50 ms, a inna może pracować w trybie batchowym i kończyć obliczenia raz na godzinę, dużo łatwiej zadecydować o umiejscowieniu poszczególnych komponentów i dobrać odpowiedni typ infrastruktury.

Latency i przepustowość: co jest wrażliwe na opóźnienia

Jednym z głównych powodów, dla których architektura hybrydowa AI różnicuje lokalizację komponentów, jest wrażliwość na opóźnienia sieciowe. Nie każdy element pipeline’u AI wymaga minimalnego latency, ale te, które go wymagają, praktycznie definiują granice tego, co może trafić do chmury.

Komponenty silnie wrażliwe na latency to m.in.:

- inferencja w systemach on‑line decyzyjnych (np. scoring transakcji w antyfraudzie, rekomendacje produktowe na stronie w trakcie wizyty użytkownika),

- AI wbudowana w systemy przemysłowe (sterowanie maszynami, wizja komputerowa w liniowych procesach produkcyjnych),

- obsługa językowa w czasie rzeczywistym (np. asystenci głosowi w call center, transkrypcja podczas rozmowy).

W takich przypadkach inferencja latency‑sensitive AI powinna być możliwie najbliżej źródła zdarzenia: na edge, w lokalnym data center, czasem w tej samej podsieci, co system bazowy. Chmura może wspierać trenowanie modeli, analizy historyczne, budowanie bardziej złożonych wersji modeli, ale próba wykonywania krytycznych inferencji przez Internet wprowadzi zbyt dużą zmienność i opóźnienia.

Z drugiej strony, komponenty typu batchowego – np. okresowe ponowne trenowanie, generowanie raportów, analiza historycznych logów, masowa klasyfikacja dokumentów – są znacznie mniej wrażliwe na latency i mogą bardzo dobrze funkcjonować w chmurze. Dodatkowo, w tych scenariuszach da się efektywnie wykorzystać skalowanie poziome i rozliczanie w modelu pay‑as‑you‑go.

Modele kosztowe: CAPEX on‑prem vs OPEX chmury

Kolejnym filarem decyzji architektonicznej jest ekonomia. On‑premise oznacza głównie CAPEX – jednorazowe lub okresowe duże wydatki na sprzęt, licencje i infrastrukturę towarzyszącą. Chmura to w większości OPEX – bieżące koszty zużycia zasobów: CPU, GPU, storage, transfer danych, usługi zarządzane.

Różnica nie sprowadza się tylko do księgowości. Profil obciążenia w czasie jest kluczowy. Jeśli trenowanie modeli wymaga ekstremalnie dużych zasobów, ale tylko przez kilkanaście dni w kwartale, budowa farmy GPU on‑prem jedynie po to, żeby przez resztę czasu się nudziła, jest wątpliwa ekonomicznie. Znacznie sensowniejsze bywa wtedy skorzystanie z GPU w chmurze do traningu, przy pozostawieniu inferencji (często lżejszej obliczeniowo) w lokalnym środowisku.

Z kolei jeśli przewidujesz stały, wysoki poziom obciążenia AI (np. setki tysięcy żądań inferencji na minutę, 24/7) i masz długi horyzont planowania, inwestycja w sprzęt on‑prem może się zwrócić. Warunkiem jest jednak dobrze policzona cena jednostkowa inferencji (np. koszt na 1000 zapytań) i uwzględnienie wszystkich kosztów ukrytych: energii, chłodzenia, utrzymania, zespołu administracyjnego, czasów przestojów.

| Aspekt | On‑premise | Chmura publiczna |

|---|---|---|

| Model kosztowy | Głównie CAPEX, amortyzacja sprzętu | OPEX, płatność za użycie |

| Skalowanie | Powolne, wymaga zakupu sprzętu | Szybkie, elastyczne, autoscaling |

| Kontrola nad danymi | Pełna kontrola fizyczna i logiczna | Kontrola logiczna, fizyczna po stronie dostawcy |

| Latency do systemów legacy | Minimalne (w tej samej sieci) | Zależne od łącza i architektury |

| Dostęp do nowego sprzętu AI | Ograniczony cyklem zakupowym | Szybki, dostępne najnowsze GPU/TPU |

| Złożoność operacyjna | Większa po stronie własnego zespołu | Część zarządzana przez dostawcę |

Regulacje i zgodność: RODO, lokalizacja danych, branże regulowane

Dla wielu organizacji motywem numer jeden do sięgnięcia po architekturę hybrydową AI są regulacje. W obszarze europejskim centralną rolę gra RODO oraz wymogi dotyczące lokalizacji danych. Instytucje finansowe, medyczne, telekomunikacyjne czy administracja publiczna często działają w otoczeniu, gdzie dane klientów nie mogą opuszczać określonego terytorium ani być przetwarzane poza określonymi strefami zaufania.

W takiej sytuacji częstym wzorcem jest przechowywanie i przetwarzanie pierwotnych danych osobowych on‑prem, wraz z silnymi mechanizmami kontroli dostępu i audytu, oraz wykorzystywanie chmury do:

- przetwarzania zanonimizowanych lub pseudonimizowanych danych,

Strategie anonimizacji i pseudonimizacji pod hybrydowe AI

Żeby móc realnie korzystać z mocy obliczeniowej chmury przy silnych ograniczeniach regulacyjnych, sam podział na „dane wrażliwe on‑prem, reszta w chmurze” nie wystarcza. Potrzebny jest powtarzalny, audytowalny proces przekształcania danych z postaci pierwotnej do postaci możliwej do wyniesienia poza lokalne środowisko.

Najczęściej stosowane podejścia to:

- pseudonimizacja deterministyczna – zamiana identyfikatorów (np. PESEL, numer klienta) na losowe, ale powtarzalne tokeny, które pozwalają łączyć dane tej samej osoby w chmurze, przy braku możliwości łatwego odwrócenia bez klucza on‑prem,

- anonimizacja nieodwracalna – usunięcie lub trwała agregacja identyfikatorów, tak aby nie dało się odtworzyć konkretnej osoby (np. zamiast dokładnej daty urodzenia – przedział wiekowy),

- maskowanie dynamiczne – stosowane częściej w narzędziach BI, ale w AI też się sprawdza: dane źródłowe pozostają on‑prem, a do chmury trafiają wyłącznie wybrane atrybuty po przekształceniu zgodnym z rolą użytkownika.

Praktyczny wzorzec to „gateway anonimizacyjny” przy granicy sieci. Jest to usługa (często w formie API) działająca w strefie on‑prem, która:

- odbiera żądania przetwarzania danych od komponentów w chmurze,

- pobiera wymagane dane źródłowe z wewnętrznych systemów,

- stosuje uzgodnione polityki anonimizacji/pseudonimizacji,

- odsyła do chmury wyłącznie wynik przekształcenia.

Taki gateway staje się pojedynczym punktem egzekwowania polityk prywatności i minimalizacji danych. Pozwala to ograniczyć ryzyko, że „boczny” proces wyśle do chmury zbyt szczegółowy wycinek danych tylko dlatego, że tak było łatwiej programistycznie.

Zarządzanie zgodnością jako część projektu architektonicznego

W hybrydowej architekturze AI warstwa governance nie może być dokumentem w SharePoincie; musi być odzwierciedlona w konkretnych komponentach i kontrolkach technicznych. Typowy zestaw elementów obejmuje:

- centralny katalog danych i procesów AI (data & model catalog) z informacją o kategoriach danych, podstawach prawnych przetwarzania i lokalizacji,

- polityki DLP (Data Loss Prevention) na granicy on‑prem/chmura, które wykrywają i blokują nieautoryzowany transfer np. danych osobowych w logach,

- audytowalne ścieżki decyzji – kto, kiedy, na jakiej podstawie zdecydował, że dany zbiór może być przetwarzany w chmurze w określonej postaci,

- mechanizmy realizacji praw podmiotów danych (np. prawo do bycia zapomnianym) obejmujące zarówno modele on‑prem, jak i te trenowane w chmurze.

W praktyce oznacza to, że projektując pipeline’y ML, trzeba z góry zdefiniować, w których krokach dane mogą zmieniać swoją „strefę” regulacyjną (np. z poziomu danych osobowych do pseudonimowych), i jakie warunki muszą być wtedy spełnione: rodzaj szyfrowania, lokalizacja regionu chmurowego, rodzaj użytej usługi (managed vs własny klaster na IaaS).

Jakie komponenty AI nadają się do chmury, a jakie na on‑premise

Warstwa danych: magazyny, jeziora danych i cache

Podział środowiska zaczyna się zwykle od warstwy danych. Sensowny punkt wyjścia to trzy kategorie:

- dane krytyczne regulacyjnie i operacyjnie – dane osobowe, finansowe, dane z systemów rozliczeniowych; zazwyczaj pozostają on‑prem,

- dane pochodne / zubożone – featury, agregacje, embeddingi, które nie pozwalają łatwo odtworzyć jednostki; często mogą trafić do chmury,

- dane nieosobowe – logi techniczne, dane z sensorów przemysłowych bez identyfikatorów; nadają się do chmury niemal od razu, o ile nie są tajemnicą przedsiębiorstwa.

Na tej podstawie wyłania się układ:

- Enterprise Data Warehouse / Lakehouse on‑prem – główne źródło danych krytycznych, z mocnymi kontrolami dostępu,

- „Cień” jeziora danych w chmurze – zasilany z on‑prem wyłącznie przetworzonymi danymi, na których działają masowe trenowania, eksperymenty, feature store w trybie read‑only,

- cache blisko inferencji – np. Redis lub wewnętrzny KV‑store w tej samej sieci, co usługa modelu, tak aby nie ściągać feature’ów z drugiego końca tunelu VPN.

W jednym z typowych scenariuszy bankowych dane transakcyjne i dane osobowe klientów pozostają w hurtowni on‑prem, natomiast do chmury wysyłane są zanonimizowane sekwencje zachowań i zagregowane cechy, na których trenowane są modele ryzyka. Sam scoring w produkcji dzieje się w data center, korzystając z modeli przeniesionych z chmury po zatwierdzeniu.

Trenowanie modeli: eksploracja w chmurze, stabilizacja on‑prem

Trening modeli, zwłaszcza głębokich sieci neuronowych, jest najbardziej zasobożerną częścią cyklu życia AI. To naturalny kandydat do chmury, z kilku powodów:

- duża zmienność zapotrzebowania na moc – okresy intensywnych eksperymentów przeplatane ciszą,

- dostęp do nowych typów akceleratorów – GPU/TPU, instancje z szybkimi sieciami,

- bogaty ekosystem usług MLOps – zarządzane pipeline’y, hyper‑parameter tuning, AutoML.

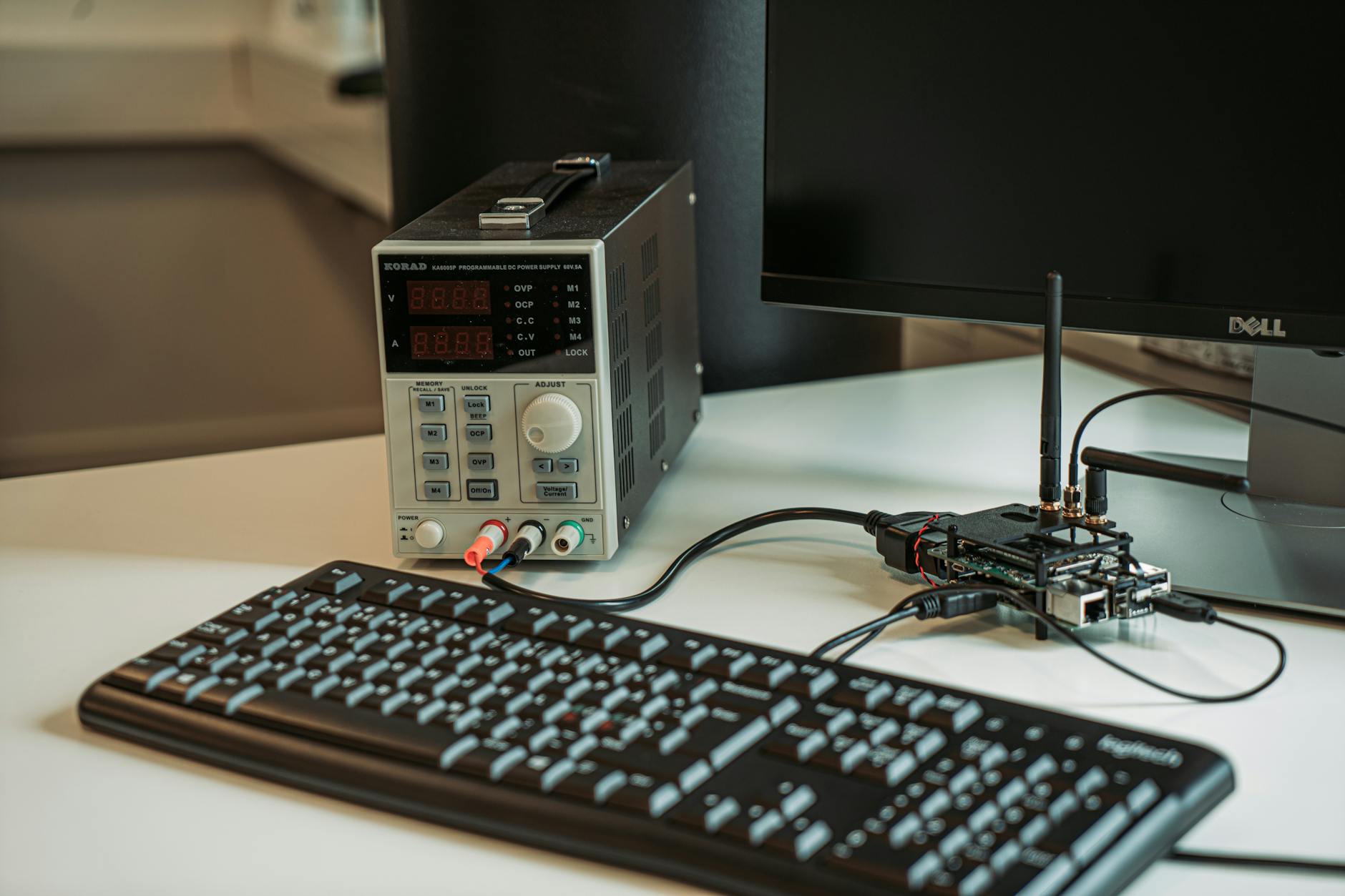

Nadal jednak zdarzają się sytuacje, w których trenowanie części modeli pozostaje on‑prem, np. gdy:

- dane nie mogą opuścić infrastruktury (regulacje, NDA, wymagania klientów B2B),

- występuje ciągły, przewidywalny wysoki popyt na trening i inwestycja we własne GPU jest policzalnie opłacalna,

- konieczne jest wykorzystanie specjalistycznego sprzętu lub połączeń z systemami laboratoryjnymi / urządzeniami przemysłowymi.

Praktyczny kompromis to model „explore w chmurze, exploit on‑prem”: eksploracja architektur i hiperparametrów na losowo wybranych, zubożonych próbkach danych w chmurze, a następnie odtworzenie wybranego pipeline’u treningowego on‑prem na pełnym zbiorze. Wymaga to dobrego utrwalenia definicji eksperymentu (np. w formie kodu i manifestów YAML w repozytorium), tak aby pipeline był przenośny między środowiskami.

Inferencja: online, batch, near‑real‑time

Dobór lokalizacji dla inferencji zależy wprost od charakteru interakcji z systemami biznesowymi:

- Online, w ścieżce krytycznej – modele, które decydują o tym, czy transakcja kartowa zostanie autoryzowana, czy maszyna zatrzyma linię produkcyjną, gdzie kilka milisekund opóźnienia ma znaczenie. Takie inferencje zwykle utrzymywane są on‑prem lub na edge, często z lokalnymi replikami modeli.

- Near‑real‑time – scenariusze, gdzie opóźnienie rzędu sekund jest akceptowalne (np. personalizacja treści w aplikacji po kilku akcjach użytkownika). Tu sensowne jest łączenie: brzegowa inferencja on‑prem z okresem synchronizacji modeli z chmury, albo pełna inferencja w chmurze, jeśli użytkownik i tak komunikuje się z nią przez Internet.

- Batch – np. nocne aktualizacje scoringów klientów, klasyfikacja milionów dokumentów raz na dzień. Te przypadki idealnie nadają się do chmury, gdzie można na kilka godzin odkręcić dziesiątki węzłów, a potem je wyłączyć.

Ciekawym kompromisem jest utrzymywanie dwóch profili modeli: „light” na on‑prem (niższa złożoność, mniejszy latency, większa przewidywalność) oraz „heavy” w chmurze (bardziej złożone, dokładniejsze). W krytycznych ścieżkach system zawsze korzysta z wersji light, a w tle wyniki mogą być walidowane droższym modelem w chmurze. Różnice trafiają do kolejki błędów i służą do poprawy modeli.

Warstwa MLOps i narzędzia wspierające

System AI bez spójnej warstwy MLOps szybko zamienia się w zbiór niespójnych skryptów. W architekturze hybrydowej dochodzi pytanie: gdzie utrzymywać rejestr modeli, pipeline’y CI/CD, monitoring?

Przydatny jest podział na:

- „źródło prawdy” dla artefaktów (kodu, definicji pipeline’ów, konfiguracji) – zazwyczaj wspólne repozytoria Git i system CI uruchamiany w chmurze lub w neutralnej strefie,

- rejestry i storage modeli – często dwa: globalny w chmurze plus replikowane, zawężone rejestry on‑prem dla modeli dopuszczonych do środowisk regulowanych,

- monitoring i observability – metryki inferencji online (latency, błędy) rozsądnie trzymać blisko usług inferencyjnych, ale ich agregacja, dashboardy i alerting mogą być w chmurze, o ile logi nie zawierają danych wrażliwych.

W praktyce organizacje często zaczynają od platformy MLOps w chmurze, a następnie dobudowują „adapter” on‑prem: cienką warstwę, która potrafi pobrać konkretne wersje modeli, uruchomić je lokalnie i raportować metryki w sposób zgodny ze standardem przyjętym w chmurze.

Wzorce architektoniczne dla hybrydowej AI

Wzorzec „cloud burst” dla trenowania i dużych batchy

„Cloud bursting” oznacza czasowe przeniesienie części obciążeń z on‑prem do chmury, gdy lokalne zasoby są przeciążone lub dany typ obciążenia lepiej pasuje do elastycznego modelu chmurowego. W AI stosuje się to głównie do:

- masowych treningów / retrainingu modeli,

- dużych zadań batchowych (np. przeliczenie wszystkich embeddingów dokumentów po zmianie architektury modelu).

Architektura obejmuje zwykle:

- kolejkę zadań (on‑prem), w której rejestrowane są potrzeby treningowe lub batchowe,

- orchestratora zadań, który podejmuje decyzję, czy uruchomić zadanie lokalnie, czy w chmurze, na podstawie aktualnego obciążenia i polityk kosztowych,

- standaryzowane kontenery/pakiety z kodem i definicją środowiska, które mogą być uruchomione zarówno na klastrze on‑prem, jak i w chmurze.

Kluczowym elementem jest użycie tych samych definicji pipeline’ów (np. w Kubeflow, Airflow, Argo) w obu środowiskach, tak aby zmiana lokalizacji uruchomienia była decyzją operacyjną, a nie wymagała przerabiania kodu.

Wzorzec „edge + cloud” dla AI blisko urządzeń

W środowiskach przemysłowych, IoT czy retail często spotykany jest układ, gdzie:

- na edge (urządzenia, brzegowe serwery, mini‑data center w sklepie lub fabryce) działają lekkie modele, przetwarzające strumienie danych w czasie zbliżonym do rzeczywistego,

- w centralnym on‑prem lub chmurze odbywa się zaawansowana analityka, retraining modeli i długoterminowa archiwizacja danych.

Edge gromadzi jedynie krótko‑terminowe buforowane dane (np. ostatnie godziny z kamer), a do centralnego środowiska wysyła zredukowane informacje: alarmy, agregaty, wybrane próbki do ponownego etykietowania. Modele aktualizowane są centralnie i dystrybuowane do urządzeń brzegowych, często przez system zarządzania flotą (fleet management).

Taki wzorzec wymusza dobre rozdzielenie versioningu modeli od samego procesu ich dystrybucji. Model musi być identyfikowany w sposób jednoznaczny (np. hash artefaktu + wersja schematu wejścia/wyjścia), niezależnie od tego, czy działa na edge, on‑prem czy w chmurze.

Wzorzec „zero‑data transfer” z wynoszeniem tylko modeli

W niektórych instytucjach (np. w obronności, części administracji publicznej) migracja jakichkolwiek danych do chmury jest niemożliwa. Nadal jednak chcą korzystać z narzędzi i usług chmurowych do budowy i zarządzania modelami.

W takim podejściu:

- wszystkie dane treningowe i inferencyjne pozostają on‑prem,

- do chmury wynoszone są metadane eksperymentów, kod i lekkie próbki syntetyczne, które pozwalają rozwijać pipeline’y,

- modele trenowane są w pełni on‑prem, ale rejestrowane również w zewnętrznym katalogu (bez wglądu w dane), w celu korzystania z funkcji governance, monitoringu wersji, automatyzacji CI/CD.

W praktyce sprowadza się to do umiejętnego rozdzielenia: „co jest danymi biznesowymi” (objętymi restrykcjami) od „co jest metadanymi procesu ML” (konfiguracje, hiperparametry, wyniki metryk). Odpowiedni model klasyfikacji informacji na poziomie architektury jest wtedy tak samo ważny, jak wybór frameworku ML.

Wzorzec „shared feature store” z dwoma warstwami

Feature store jest jednym z newralgicznych elementów platformy ML, a w architekturze hybrydowej komplikuje go różnica lokalizacji danych. Z jednej strony przydaje się wspólna semantyka cech (definicje, transformacje, testy jakości), z drugiej – nie zawsze można replikować całość danych do chmury.

Praktyczne podejście to dwuwarstwowy feature store:

- warstwa logiczna/globalna – definicje cech, ich schemat, kod transformacji, testy jakości, polityki uprawnień,

- warstwa fizyczna/lokalna – materializacja cech w konkretnych magazynach: raz w chmurze (np. BigQuery/Redshift), raz on‑prem (np. Hive, baza kolumnowa, system time‑series).

Globalny katalog trzyma metadane: jaka cecha istnieje, jak jest liczona, jakie ma SLA odświeżania, gdzie znajduje się jej materializacja. Same wartości cech pozostają tam, gdzie musi pozostać surowy data lake: w sieci wewnętrznej instytucji lub w chmurze publicznej.

W takim układzie istotne stają się:

- deterministyczne transformacje – ten sam kod (np. funkcje w repozytorium, joby Spark/Beam/Flink w kontenerach) musi działać identycznie na obu platformach,

- spójne time travel – możliwość odtworzenia historii cech zarówno on‑prem, jak i w chmurze (np. przez partycjonowanie po czasie lub wersjonowanie snapshotów),

- kontrola „gravity danych” – cechy bardzo wrażliwe (np. dane medyczne) materializowane są wyłącznie on‑prem, w chmurze dostępna jest jedynie wersja zanonimizowana lub skwantyzowana.

Gdy zespoły data science chcą pracować w chmurze na próbce danych, orchestrator feature store’a tworzy tam tymczasowe, ograniczone widoki tych samych cech – np. z losowym samplingiem i maskowaniem identyfikatorów. Pozwala to eksperymentować w podobnych warunkach statystycznych, bez naruszania zasad bezpieczeństwa.

Przepływ danych w architekturze hybrydowej: minimalizacja tarcia i kosztów

Segmentacja strumieni i batchy

W hybrydowym środowisku kluczowe jest rozdzielenie typów przepływów danych. Inaczej projektuje się kanał do streamingu zdarzeń z fabryki, a inaczej – eksport historycznych danych klientów do uczenia modeli.

Przydatny jest podział na trzy klasy:

- strumienie operacyjne – logi zdarzeń, telemetria, sensory; często agregowane on‑prem, a do chmury trafiają w formie przetworzonych, skompresowanych komunikatów,

- batchy analityczne – okresowe zrzuty tabel, snapshoty hurtowni; zwykle przesyłane oknem czasowym (np. noc), by korzystać z tańszych pasm i uniknąć wpływu na systemy transakcyjne,

- kanały modelowe – specyficzne przepływy do trenowania i inferencji (np. rejestracja danych do feature store’a, zapisy inferencji online, logi predykcji).

Jeśli każdy typ przepływu ma osobny, jasno zdefiniowany kanał (np. dedykowany topic w Kafka/Redpanda on‑prem i dedykowane kolekcje/tematy w chmurze), łatwiej kontrolować koszty transferu i narzucać odpowiednie polityki retencji.

Minimalizacja ruchu między on‑prem a chmurą

Największe koszty i opóźnienia pochodzą zwykle z transferu danych między środowiskami. Projektując architekturę, lepiej przyjąć domyślną zasadę: przesuwamy kod do danych, nie dane do kodu. Konsekwencje są dość konkretne:

- pipeline treningowy kompaktowany jest w kontener lub paczkę, którą można uruchomić w klastrze blisko danych (on‑prem albo w chmurze),

- do przeniesienia między środowiskami wybierane są tylko najbardziej informacyjne produkty pośrednie – np. wektory embeddingów zamiast pełnych tekstów, zliczone agregaty zamiast surowych zdarzeń,

- do chmury trafiają logi inferencji zmaskowane (np. bez pełnych identyfikatorów klientów), jeżeli mają służyć głównie do monitoringu i detekcji driftu, a nie do biznesowych raportów.

W projektach, w których początkowo zakładano pełną replikację jeziora danych do chmury, często po kilku miesiącach okazuje się, że wystarczyłoby przenoszenie zaledwie kilku wybranych tabel lub lekkich reprezentacji danych (embeddingi, top‑N cech). To argument za wprowadzeniem czasu życia danych międzyśrodowiskowych (data transfer TTL): domyślnie migrują one jedynie na czas trenowania, a potem są automatycznie usuwane lub archiwizowane w miejscu docelowym.

Standaryzacja formatów i schematów

Przepływy między on‑prem i chmurą wymagają wspólnego języka. Jeśli po jednej stronie dane są w Parquet, a po drugiej w niestandardowych binariach, każdy transfer kończy się kosztowną translacją. Spójność formatów upraszcza nie tylko migrację, lecz także debugowanie.

Typowym wyborem są:

- Parquet/ORC dla batchy tabelarycznych,

- Avro/Protobuf dla komunikatów strumieniowych,

- JSON/NDJSON jako format wymienny tam, gdzie potrzebna jest łatwa inspekcja przez ludzi.

Obok formatów potrzebny jest centralny katalog schematów – czy to w postaci narzędzia typu schema registry, czy repozytorium z kontraktami API. Powinien obejmować:

- wersjonowanie schematów wejść/wyjść modeli,

- mapowanie pól między systemami źródłowymi a feature store’em,

- polityki ewolucji (backward/forward compatibility), aby zmiana w on‑prem ETL nie psuła treningów w chmurze.

Nadzór operacyjny nad przepływami

Gdy między środowiskami krąży wiele strumieni, bez nadzoru szybko pojawiają się „tajne” integracje i tunelowanie danych przez narzędzia, o których nikt już nie pamięta. Żeby utrzymać kontrolę, przydają się:

- jednolity katalog przepływów (data lineage), który opisuje, skąd i dokąd płyną dane,

- tagowanie przepływów kosztowych – każdemu połączeniu sieciowemu do chmury przypisane są etykiety projektu/produktu, co pozwala rozliczać zużycie,

- limity i throttling – na poziomie gateway’a lub VPN, by pojedynczy job treningowy nie zapchał łącza na kilka godzin.

W dojrzałych organizacjach architekt ustala proste reguły: np. „żaden nowy system AI nie może wymagać stałego transferu większego niż X MB/s między on‑prem a chmurą bez przeglądu architektonicznego”. To zmusza zespoły do lokalnej agregacji i przemyślenia decyzji, gdzie dane powinny „ciążyć”.

Wydajność i optymalizacja: jak mierzyć i gdzie stroić

Metryki techniczne i biznesowe

Optymalizacja hybrydowej architektury AI nie polega tylko na skracaniu czasu trenowania. Wydajność trzeba definiować jednocześnie w wymiarze technicznym i biznesowym. Typowy zestaw obejmuje:

- metryki techniczne – throughput (żądania/s), latency percentyle, wykorzystanie GPU/CPU, I/O, czas pipeline’u od danych surowych do modelu,

- metryki kosztowe – koszt jednostkowy inferencji (na żądanie), koszt jednostkowy treningu (na epokę, na tysiąc rekordów), koszt transferu danych per job,

- metryki biznesowe – SLA odpowiedzi modelu w ścieżce transakcyjnej, okno opóźnienia aktualizacji modelu (model freshness), wpływ na KPI produktu (np. konwersja, czas przestoju linii).

Bez widoku na wszystkie te wymiary, łatwo wpaść w pułapkę „taniej w chmurze”, która ignoruje opóźnienia sieciowe i koszty egressu, lub odwrotnie – „bezpieczniej on‑prem”, które pomija brak elastyczności i czas wdrożeń.

Gdzie stroić: on‑prem vs chmura

Zakładając, że przepływy są już ustalone, pytanie brzmi: w którym miejscu inwestować w optymalizację? Odpowiedź zależy od dominującego ograniczenia:

- jeśli wąskim gardłem jest GPU/CPU podczas treningu – zwykle sensowniejsze jest strojenie w chmurze: autoscaling, wybór typów instancji, optymalizacja schedulerów treningów,

- jeśli problemem jest latency inferencji w krytycznej ścieżce – optymalizacja odbywa się on‑prem: kompresja modeli (quantization, pruning), przyspieszanie runtime (ONNX Runtime, TensorRT, OpenVINO), pinning instancji na konkretnych węzłach,

- jeżeli koszty transferu danych stanowią zauważalny procent budżetu – trzeba redukować liczbę i rozmiar przepływów: lokalna agregacja, stratyfikowany sampling, caching wyników.

W praktyce wiele zespołów zaczyna od prostego „lift & shift” – przeniesienia treningów do chmury bez większych zmian – a dopiero potem dokonuje refaktoryzacji pipeline’ów pod kątem efektywności. Często drobne zmiany (np. wcześniejsze filtrowanie nieużywanych kolumn lub uproszczenie transformacji czasowych) dają większy zysk niż zmiana typu instancji na droższą.

Profilowanie end‑to‑end

Strojenie fragmentów bez zrozumienia całości łańcucha bywa mylące. Modele działające w dwóch lokalizacjach wymagają profilowania end‑to‑end – od wejścia danych do systemu biznesowego, aż po zapis wyniku inferencji lub modelu.

Przydaje się tu kilka zasad:

- czas mierzony przy granicach – logowanie timestampów przy przejściu między mediami (on‑prem → chmura, chmura → on‑prem); pozwala to wyizolować problemy sieciowe,

- oznaczanie requestów kontekstem (correlation ID) wspólnym dla wszystkich środowisk,

- oddzielne mierzenie „czasu modelu” (samo wywołanie modelu) od czasu overheadów (serializacja, walidacja, routing, autoryzacja).

Na tej podstawie łatwo zidentyfikować przypadki, gdy większość opóźnienia nie wynika z modelu, lecz z warstwy integracyjnej (np. zbyt częste wywołania między mikroserwisami, powtarzająca się walidacja tych samych danych).

Eksperymenty architektoniczne A/B

Tak jak modele testuje się w ramach A/B testów, podobnie można porównywać warianty architektury. Przykład: część ruchu inferencyjnego kierowana jest do modeli on‑prem, a część do modeli w chmurze; różnice w latency, kosztach i stabilności są mierzone w czasie.

Dobrze zaprojektowana bramka routująca (API gateway, service mesh) powinna umożliwiać:

- procentowe rozdzielanie ruchu między środowiska,

- warunkowe routowanie (np. klienci z danego regionu zawsze on‑prem),

- stopniowe przesuwanie ruchu po zebraniu metryk (progressive rollout).

Takie eksperymenty są szczególnie użyteczne przy stopniowej migracji starszych systemów on‑prem do chmury. Zamiast „big bang” z jednym terminem przełączenia, można przenosić poszczególne segmenty ruchu i obserwować skutki.

Bezpieczeństwo, prywatność i zgodność w hybrydowym świecie AI

Model klasyfikacji informacji

Bez klarownej klasyfikacji informacji trudno prowadzić spójne decyzje o tym, co może trafić do chmury. W obszarze AI przydatne są co najmniej trzy kategorie:

- dane wrażliwe – dane osobowe, medyczne, finansowe, dane klientów objęte NDA; często muszą pozostać wyłącznie on‑prem lub w chmurze dedykowanej (np. sektorowej),

- dane operacyjne – logi systemów, metryki techniczne, dane o wydajności; zwykle mogą trafiać do chmury, jeśli są zanonimizowane,

- metadane ML – konfiguracje modeli, hyperparametry, wyniki walidacji, statystyki dystrybucji; najczęściej najmniej regulowane, można je przechowywać w chmurze nawet w scenariuszach „zero‑data transfer”.

Na tej bazie tworzy się mapę: które pipeline’y dotykają której klasy danych, jakie warunki muszą spełnić (szyfrowanie, tokenizacja, pseudonimizacja), jakie są dozwolone lokalizacje przetwarzania.

Szyfrowanie i zarządzanie kluczami

W hybrydzie spotykają się różne systemy kryptograficzne. Dane mogą być szyfrowane w spoczynku w chmurze, innymi kluczami on‑prem, a jeszcze innymi podczas transferu. Spójność zapewnia centralna polityka zarządzania kluczami (KMS), a przynajmniej wspólne zasady:

- klucze do danych wrażliwych przechowywane są w HSM on‑prem lub w dedykowanych modułach chmurowych (HSM as a Service),

- modele trenowane na danych wrażliwych są oddzielane logicznie (osobne konta/projekty chmurowe, osobne przestrzenie nazw w klastrach),

- dostęp do kluczy dla jobów treningowych i inferencyjnych jest ściśle powiązany z tożsamością usługi (service account), a nie użytkownika.

Najczęściej zadawane pytania (FAQ)

Kiedy architektura hybrydowa AI ma większy sens niż „tylko chmura” lub „tylko on‑premise”?

Model hybrydowy zwykle wygrywa, gdy łączą się cztery czynniki: wysokie wymagania wydajnościowe, duże zbiory danych historycznych on‑prem, okresowe piki obciążenia oraz twarde wymogi regulacyjne dotyczące lokalizacji danych. W takim układzie pełna migracja do chmury jest kosztowna i ryzykowna, a utrzymywanie wszystkiego lokalnie – mało elastyczne i trudne do skalowania.

Jeśli system AI korzysta z wrażliwych danych (np. finansowych, medycznych), ale jednocześnie wymaga bardzo dużej mocy obliczeniowej na czas trenowania modeli lub eksperymentów, architektura hybrydowa pozwala: trzymać i przetwarzać dane krytyczne lokalnie, a wymagające obliczeniowo zadania „wypychać” do chmury tylko wtedy, gdy jest to potrzebne.

Jakie są najczęstsze scenariusze łączenia on‑premise z chmurą w projektach AI?

Da się wyróżnić kilka powtarzalnych wzorców. Najpopularniejszy to trenowanie modeli w chmurze i uruchamianie inferencji lokalnie – model powstaje na elastycznych zasobach GPU w chmurze, a po wytrenowaniu jest wdrażany blisko systemów transakcyjnych on‑prem, co zapewnia niską latencję i pełną kontrolę nad danymi produkcyjnymi.

Drugi często spotykany scenariusz to trzymanie danych wrażliwych on‑prem przy jednoczesnym wykorzystaniu mocy obliczeniowej chmury do analizy zanonimizowanych lub zagregowanych danych. Trzeci to rozdzielenie inferencji pomiędzy edge, lokalne data center i chmurę: proste, częste zapytania obsługiwane są „bliżej użytkownika”, a tylko złożone lub rzadkie przypadki trafiają do chmury.

Jak ocenić, które komponenty systemu AI umieścić w chmurze, a które on‑premise?

Punkt wyjścia to podział całego łańcucha przetwarzania na fazy: ingest, walidacja, feature engineering, trenowanie, inferencja, monitoring. Dla każdej z nich trzeba określić wymagania co do latencji, dostępności, wrażliwości danych oraz charakterystyki obciążenia (ciągłe vs. burstowe). Komponenty z danymi krytycznymi i wymagające bardzo niskich opóźnień zwykle zostają on‑prem; te o profilu batchowym, eksperymentalnym lub sezonowym trafiają do chmury.

Dodatkowo warto spojrzeć na koszty: co jest tańsze w CAPEX (sprzęt lokalny), a co w OPEX (zasoby chmurowe na żądanie). Przykład z praktyki: hurtownia danych i system scoringowy działają on‑prem, natomiast eksperymenty z nowymi modelami i okresowe retreningi są wykonywane w chmurze na krótkotrwale uruchamianych klastrach GPU.

Na czym polega różnica między świadomą architekturą hybrydową a prostym „lift‑and‑shift” do chmury?

Lift‑and‑shift to przeniesienie istniejących komponentów do chmury bez zmiany ich logiki czy podziału odpowiedzialności. Typowy przykład: baza danych zostaje on‑prem, aplikacja AI ląduje w chmurze, a całość łączy VPN. Formalnie to hybryda, ale zwykle bez realnych zysków wydajnościowych czy kosztowych – za to z dodatkowymi opóźnieniami i złożonością sieciową.

Świadoma architektura hybrydowa zakłada od razu, że różne elementy systemu mogą działać w różnych środowiskach. Analizuje się dane, przepływy, SLO i ograniczenia regulacyjne, a dopiero potem projektuje podział: co dokładnie przenieść, co zostawić, co zrefaktoryzować. Efekt to układ, w którym zmiana środowiska jest narzędziem optymalizacji, a nie skutkiem ubocznym migracji.

Jak SLA, SLO i SLI pomagają projektować architekturę hybrydową AI?

SLI to konkretny wskaźnik (np. średni czas odpowiedzi modelu, procent żądań poniżej 100 ms, koszt inferencji na 1000 zapytań). SLO definiuje cel dla SLI, np. 99,9% żądań obsłużonych poniżej 200 ms. SLA to już formalna umowa, która wiąże te cele z konsekwencjami biznesowymi, np. karami umownymi lub priorytetem wsparcia.

Jeśli dla danego komponentu AI zdefiniujesz jasne SLO, dużo łatwiej zdecydować o jego umiejscowieniu. Części z wymaganiami typu „<50 ms end‑to‑end w godzinach szczytu” zwykle trafiają on‑prem lub na edge. Elementy o SLO na poziomie minut czy godzin (batch, trenowanie, archiwizacja) mogą bez problemu działać w chmurze, co od razu porządkuje architekturę.

Jakie ryzyka i wyzwania wiążą się z architekturą hybrydową AI?

Kluczowe ryzyka to zwiększona złożoność integracji, koszty transferu danych i problemy z debugowaniem na styku on‑prem/chmura. Pojawia się też potrzeba spójnego zarządzania bezpieczeństwem i tożsamością w dwóch różnych domenach, a także monitoringiem, który obejmuje zarówno infrastrukturę lokalną, jak i chmurową.

Źle zaprojektowana hybryda potrafi być droższa i wolniejsza niż wariant „tylko chmura” lub „tylko on‑prem”. Dlatego przy projektowaniu trzeba jasno zdefiniować, jakie mierzalne korzyści ma dać rozdzielenie środowisk (np. niższy TCO, lepsze SLO, spełnienie konkretnych wymogów regulacyjnych) i pilnować ich w trakcie rozwoju systemu.

Jak podejść do kosztów w hybrydowej architekturze AI: CAPEX vs OPEX?

Infrastruktura on‑prem to głównie CAPEX: duży wydatek początkowy na sprzęt (GPU, CPU, storage, sieć), który amortyzuje się w czasie. To opłacalne przy stałym, przewidywalnym obciążeniu, gdy zasoby będą intensywnie wykorzystywane przez kilka lat. Natomiast chmura to OPEX – płacisz za rzeczywiste użycie, co lepiej pasuje do obciążeń zmiennych, sezonowych, eksperymentalnych.

Praktyczne podejście w hybrydzie jest takie: stałe, krytyczne komponenty i podstawowa moc obliczeniowa lądują on‑prem, natomiast „górki” obciążeń, retreningi, eksperymenty i analizy ad‑hoc korzystają z chmury. Pozwala to uniknąć przewymiarowania własnej serwerowni wyłącznie po to, żeby obsłużyć rzadkie piki zapotrzebowania na moc obliczeniową dla AI.

Źródła informacji

- NIST Cloud Computing Reference Architecture. National Institute of Standards and Technology (2011) – Definicje modeli chmury, w tym hybrid cloud i role architektoniczne

- The NIST Definition of Cloud Computing (SP 800-145). National Institute of Standards and Technology (2011) – Podstawowe modele usług i wdrożeń chmury, w tym hybrid cloud

- ISO/IEC 17788:2014 Information technology — Cloud computing — Overview and vocabulary. International Organization for Standardization (2014) – Słownik pojęć chmurowych: IaaS, PaaS, SaaS, modele wdrożenia

- Architecting for the Cloud: Best Practices. Amazon Web Services – Praktyki projektowania systemów w chmurze, koszty, skalowanie, CAPEX/OPEX

- Hybrid and Multicloud Patterns for Architecture and Deployment. Microsoft – Wzorce architektoniczne dla środowisk hybrydowych i multi‑cloud

- Google Cloud Architecture Framework. Google Cloud – Zalecenia dot. wydajności, niezawodności i kosztów w architekturach chmurowych

- MLOps: Continuous Delivery and Automation Pipelines in Machine Learning. O’Reilly Media (2020) – Praktyki MLOps, cykl życia modeli, trenowanie vs inferencja

- General Data Protection Regulation (EU) 2016/679. European Union (2016) – Wymogi RODO dot. lokalizacji i przetwarzania danych osobowych

- ENISA Report: Security and Privacy Considerations in Cloud Computing. European Union Agency for Cybersecurity – Ryzyka bezpieczeństwa i prywatności w chmurze, aspekty regulacyjne

- Cloud Security Guidance. National Cyber Security Centre – Wytyczne bezpieczeństwa dla usług chmurowych, w tym modeli hybrydowych